Los fails más épicos de las recomendaciones de apps

En La Jungla. La Inteligencia Artificial promete resolver gran parte de nuestros problemas. Mientras eso no sea así, tendremos que entretenernos con sus fails.

Una de las falsas esperanzas que la humanidad tiene depositada en la informática, así en general, es que esta última sea capaz de solucionar todo tipo de problemas habidos y por haber. Sin embargo, no nos damos cuenta de que al ser algo creado por nosotros, inevitablemente, va a arrastrar nuestros errores, preconcepciones y demás taras mentales que tengamos.

Es por eso que en la era de la Inteligencia Artificial, muchos soñamos con que las máquinas aprendan de nuestros errores y nos presenten soluciones nuevas y definitivas a nuestros problemas. Aunque hay que reconocer que esto puede tardar décadas en suceder.

Así que por el momento vamos a disfrutar de los errores más graciosos que los algoritmos que nosotros codificamos nos presentan para darnos cuenta de quienes somos en realidad.

Por ejemplo, no todas las películas de bichitos son iguales.

yes netflix. you’re absolutely right... pic.twitter.com/rdZT5sHhlb

— W. Chaos (@WhosChaos) 10 de diciembre de 2017

Recordemos que Bichos es una película infantil, pero el Ciempiés Humano es una película de terror en la que un científico tarado se dedica a atar... bueno, la boca de sus víctimas con el trasero de otras, para crear la quimera que da título al nombre. Y sí, como te puedes imaginar es una película tremendamente desagradable y con altos niveles de gore.

Ni todos los post con más visitas son material para atraer a más amigos a conectar contigo.

Instagram is using one of my most "engaging" posts to advertise its service to others on Facebook 😂 pic.twitter.com/lyEBHQXMfa

— Olivia Solon (@oliviasolon) 21 de septiembre de 2017

No todo se ciñe a las redes sociales, desde luego. Uno de los campos más interesantes en la aplicación de algoritmos es la conducción autónoma de vehículos. En este sentido, la compañía que lleva la delantera es, sin duda, Tesla. Y ni siquiera ellos se libran de los fails. Antes de que se cumpla el primer minuto ya vemos 2 fallos.

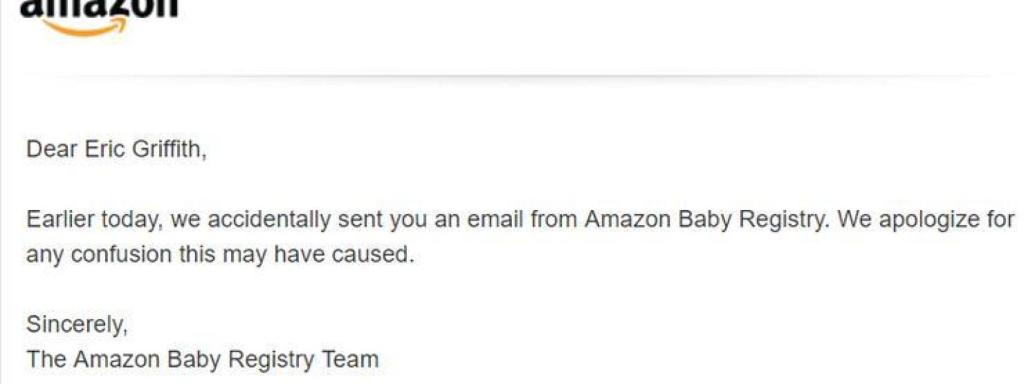

El siguiente fail es casi tan peligroso como el primero, o incluso más. Resulta que Amazon tiene una opción para crear una lista con cosas para bebés, como si fuese una lista de bodas. El caso es que mucha gente en los EE.UU. las utiliza cuando hace el anuncio del embarazo y otras muchas las hacen para ser precavidos. Adivinen a quién le llegó una notificación sin saber que estaban embarazados.

Seguimos con Amazon ya que sus tentáculos son infinitos y una de sus prestaciones más aplaudidas se convirtió hace unos meses en una de sus pesadillas. Nos referimos al apartado de "productos que se compran juntos habitualmente".

En ese pequeño recuadro, los reporteros de Channel 4 del Reino Unido descubrieron varios productos sospechosos que, juntos, podrían usarse para fabricar una bomba. Evidentemente el tema saltó a las noticias de inmediato y Amazon se puso manos a la obra para investigar porqué se recomendaba algo así. Al final todo resultó ser legal en las islas británicas y no era más que componentes de fuegos artificiales.