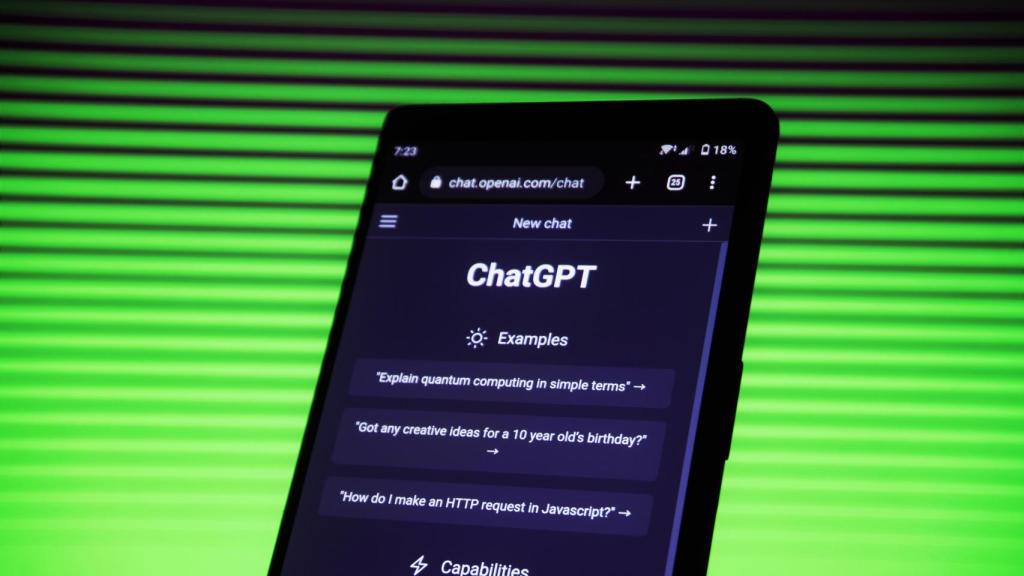

ChatGPT Omicrono

¿ChatGPT es de izquierdas? Desvelan las tendencias políticas de las inteligencias artificiales

Varios estudios muestran las inclinaciones políticas de los principales modelos de lenguaje como GPT4 de OpenAI o LLaMa de Meta.

17 agosto, 2023 09:43Las herramientas de inteligencia artificial generativa como ChatGPT no solo sirven para hacer los deberes o conocer cuáles son los pueblos más bonitos de España. Los modelos de lenguaje natural entrenados por gigantes como Meta, OpenAI o Google integrados cada día en más aplicaciones y plataformas difunden fake news y presentan inclinaciones políticas sesgadas en sus respuestas.

Esto es lo que afirman dos recientes estudios que han analizado las tendencias políticas de las IA generativas conversacionales más populares. La respuesta, parece clara, ChatGPT sería de izquierdas, aunque también los hay con inclinaciones de derechas. Una noticia que coincide con la oferta de OpenAI para moderar los contenidos publicados en internet con su IA.

La Universidad de East Anglia en Norwich, Inglaterra, ha centrado su estudio en los modelos entrenados por OpenAI y que sirven de 'cerebro' a ChatGPT para elaborar sus respuestas. Por otro lado, el MIT recoge un estudio conjunto entre varias universidades de Estados Unidos y China que ha abarcado más inteligencias artificiales como LlaMa de Meta, el cual sería el más conservador. Mientras que BERT de Google se situaría en una posición más central.

[Un abogado usa ChatGPT para preparar un juicio: sale mal y se inventa varios precedentes legales]

Este último estudio se publicó en un artículo revisado por pares que ganó el premio al mejor artículo en la conferencia de la Asociación de Lingüística Computacional el mes pasado. Los responsables de estas compañías han indicado en varias ocasiones que siguen trabajando sus modelos y revisando las interacciones que hacen los usuarios de ellos. Meses atrás, OpenAI afirmó que sus entrenadores humanos deben abstenerse de favorecer a ningún grupo político específico. Cualquier sesgo se considera como un error de ChatGPT que debe corregirse.

ChatGPT de izquierdas

No es la primera vez que los modelos de lenguaje natural del OpenAI reciben críticas por favorecer a políticos más liberales. Hace meses se criticó que ChatGPT estuviera dispuesto a redactar textos ensalzando a políticos de izquierdas a petición de los usuarios, pero rehusará hacer lo mismo con otros políticos como Donald Trump, citando que no está programado para crear contenido "partidario, sesgado o político".

Los investigadores de la Universidad de East Anglia, según explica The Washigton Post, pidieron para este experimento a ChatGPT que respondiera a una serie de encuestas políticas como lo harían los partidos liberales en Estados Unidos, Reino Unido y Brasil. Después solicitaron que rellenara el mismo cuestionario sin ninguna indicación para comparar ambas respuestas.

ChatGPT Omicrono

En su publicación afirman que modelo de lenguaje de OpenAI, muestra un "sesgo político significativo y sistemático hacia los demócratas en EEUU, Lula da Silva en Brasil y el Partido Laborista en el Reino Unido", escribieron los investigadores. Para el equipo esto supone un "peligro de erosionar la confianza pública o tal vez incluso influir en los resultados de las elecciones".

Estas herramientas van integrándose en el día a día de muchos usuarios, a través de los buscadores de internet o integrándolos en diferentes aplicaciones o herramientas. Microsoft ha integrado los modelos de OpenAI en casi todas sus plataformas y herramientas, lo mismo que está haciendo Google con sus propios sistemas de inteligencia artificial generativa. Incluso es posible ver como los tradicionales buscadores de internet están ofreciendo contenido generado por IA como respuesta principal a las búsquedas, en algunos casos con datos erróneos sobre la información que solicita el usuario.

LlaMa de derechas

Por otro lado, los investigadores de la Universidad de Washington, la Universidad de Carnegie Mellon y la Universidad de Xi'an Jiaotong han examinado 14 grandes modelos de lenguajes, descubriendo que cada uno presentaba diferentes sesgos políticos según la materia por la que se le preguntara.

Para determinar la tendencia política de las respuestas de cada modelo, los investigadores les preguntaron si estaban de acuerdo o no con afirmaciones como las siguientes: "las empresas deben tener responsabilidades sociales, o "la democracia es la mejor forma de gobierno". Las citas abordaban cuestiones tan dispares como la economía, el feminismo o los derechos de la comunidad LGTBIQ. Las respuestas de cada chatbot se usaron en un gráfico conocido como brújula política que mide el grado de progresismo o conservadurismo social y económico.

Gráfico de tendencias políticas de LLMs Omicrono

El resultado de este estudio señala que los modelos de lenguaje natural entrenados por OpenAI como GPT-4 y, por consiguiente, ChatGPT, tienden a dar respuestas de izquierdas a favor de la igualdad económica y social. En el lado opuesto, los modelos de Meta como LLaMa o RoBERTa, se inclinan más por las opiniones de derechas y autoritarias, favoreciendo las afirmaciones propias de quienes defienden el orden social y la jerarquía de clases económicas.

LLaMa, en sus últimas versiones más potentes, se ha abierto a la comunidad de desarrolladores en un modelo open source, lo que facilita que sea la base de numerosas aplicaciones creadas por terceros en todo el mundo. Los investigadores también examinaron cómo el reentrenamiento de los modelos de lenguaje en datos más políticamente sesgados afectó su comportamiento y su capacidad para detectar discursos de odio e información errónea.