YouTube.

YouTube no quiere clones de Bad Bunny: así regulará las canciones y vídeos hechos con IA

La plataforma de Google lanzará una serie de medidas con el fin de controlar los vídeos generados con inteligencia artificial.

14 noviembre, 2023 18:12La inteligencia artificial generativa ha llegado a todos los puntos y rincones del Internet de nuestra época. En España y en el resto del mundo se han dado todo tipo de situaciones que han obligado a las principales potencias a regular esta tecnología que ya ha recibido más de una advertencia. Una nueva empresa se dispone a regular la IA en una de las grandes plataformas actuales: YouTube, que adoptará medidas.

La plataforma de vídeo bajo demanda más importante del mundo ha decidido promulgar una serie de cambios que estarán dirigidos a lo que Google califica como la "innovación responsable de la IA". Es decir, limitar los malos usos de la inteligencia artificial, imponiendo limitaciones y requisitos nuevos en varios de sus puntos clave. Esto ocurre después de la queja de artistas como Bad Bunny sobre el uso de su voz en IA.

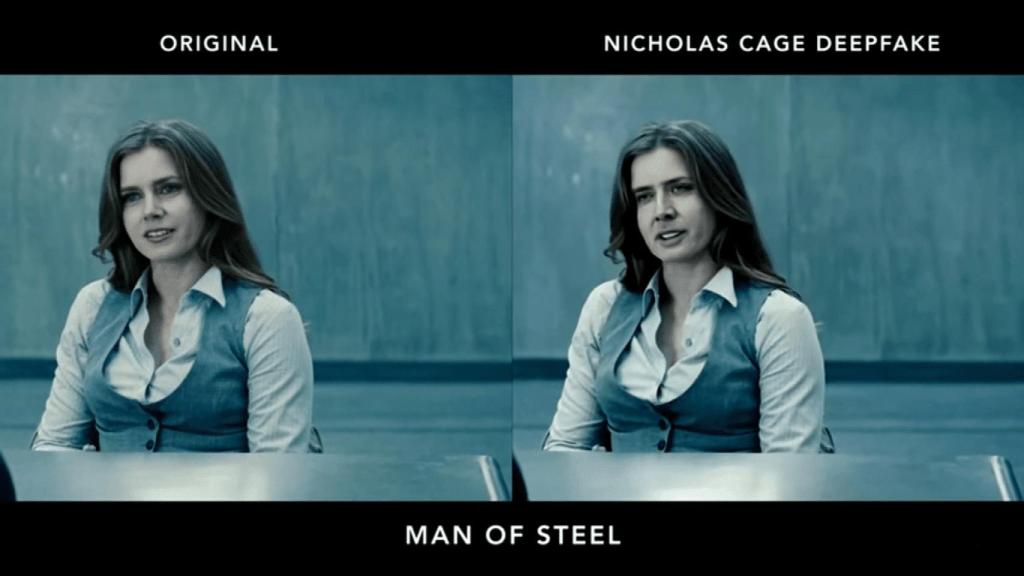

Así lo detalla Google en su blog oficial en español. Algunas de estas medidas incluyen obligar a los creadores a declarar el uso de IA y etiquetar sus contenidos generados por inteligencia artificial. Además, se podrán denunciar contenidos generados por IA como los deepfakes, especialmente los que "simulen a una persona identificable, incluidos su rostro y su voz".

Marcar vídeos con IA

Uno de los aspectos más importantes que YouTube resalta con estas medidas es dejar claro el uso de IA en los vídeos. Los expertos han estado advirtiendo durante meses que las consecuencias de la inteligencia artificial para con la información pueden ser desastrosas, y se pueden dar casos de manipulación y desinformación flagrantes. YouTube quiere evitar eso obligando a declarar el uso de estas novedades.

Según afirma en el comunicado, cuando los creadores presenten "contenidos realistas manipulados o sintéticos (lo que incluye el uso de herramientas de IA) les exigiremos que lo declaren". Así, Google dispondrá a los usuarios de nuevas opciones para indicar que el vídeo tiene este tipo de material, aclarando ciertas situaciones, como "un suceso que en realidad no ha ocurrido o que muestre a una persona real diciendo o haciendo algo que en realidad no hizo".

Comparación entre un vídeo original y un deepfake.

Google deja claro que si un creador de contenido no marca este contenido (especialmente el referente a temas sensibles "como elecciones, conflictos, crisis sanitarias o miembros del gobierno") este se eliminará por completo. Además, los usuarios como tales serán suspendidos del programa de socios de YouTube, e incluso podrán ser sancionados gravemente.

En tales casos, será Google la que advierta a los usuarios de este contenido agregando una etiqueta a las descripciones indicando "qué parte del contenido ha sido alterado o generado digitalmente". Si el contenido trata temas sensibles, se aplicará esta etiqueta directamente en el reproductor de vídeo. Y finalmente, si nada de esto sirve, directamente los vídeos se borrarán en caso de generar problemas más serios.

Adiós a los deepfakes

Otra de las cuestiones más problemáticas respecto a la IA han sido los deepfakes, ya sean en vídeo o en audio. Canciones y vídeos que hacen uso de la cara de una persona (o su voz) para generar o bien contenido gracioso y divertido o directamente contenido dañino y peligroso. Incluso en el primer caso, algunas voces han hablado de los problemas de derechos de autor que generan estos deepfakes, siendo por ejemplo uno de los puntos centrales de la huelga de actores de Hollywood.

Ejemplo de un 'deepfake' hecho con Mark Zuckerberg.

Así, los artistas que no quieran ver su cara o voz reflejados en un deepfake en YouTube podrán denunciar estos vídeos. Se abrirá un nuevo proceso de reclamación de privacidad para solicitar que se borren contenidos generados por IA "y de otros contenidos sintéticos o manipulados", que imiten a una persona incluyendo su rostro y su voz.

Pero ¿qué factores usará Google para determinar qué es un deepfake y qué no? La compañía asegura que algunos de estos incluirán determinar si el contenido presenta a ciertos tipos de personas o la propia naturaleza del vídeo. "Se tendrá en cuenta si el contenido es una parodia o una sátira, si la persona que presenta la solicitud puede identificarse de forma inequívoca o si el contenido presenta a un político o alto funcionario".

Captura de pantalla del vídeo deepfake de Sedar Soares. YouTube

Afirman que en el caso de que se use un deepfake de una persona famosa se admitirá "una mayor permisividad", aunque los músicos tendrán más preferencia en este asunto al ser algunos de los más damnificados. Podrán solicitar que se retiren contenidos musicales que recreen o la voz o la forma de cantar de estos artistas y se tendrán en cuenta factores distintos; la cobertura mediática, las críticas, el uso de voces sintéticas, etcétera.

Por último, Google promete que se revisarán los malos usos de las propias herramientas de IA que YouTube ofrece en su plataforma, ya sea para moderar contenidos o para asistencia en vídeos. Estas nuevas novedades se aplicarán a las Normas de la comunidad en los próximos meses y a lo largo de 2024.

También te puede interesar...

- El negocio de desnudar por IA. ¿Cómo proteger a las mujeres víctimas del 'deepfake'?

- No es Tom Cruise aunque lo parezca: este tiktoker arrasa con su deepfake

- Facebook borra un deepfake de Zelensky en el que se rinde ante Rusia

- El gran peligro de la inteligencia artificial: podría usarse para crear nuevas armas biológicas