Un aspirador de prueba, responsable de imágenes filtradas El Androide Libre

Un robot aspirador toma imágenes privadas de varios usuarios y acaban en Facebook

Se filtran imágenes privadas tomadas por un robot aspirador que han acabado en grupos privados de Facebook y ponen de manifiesto los riesgos de estos dispositivos.

El peor miedo de muchas personas se ha hecho realidad para una mujer venezolana y otros usuarios cuyo aspirador inteligente —en pruebas— y su reconocimiento de espacios han provocado que imágenes suyas en casa hayan acabado en Facebook.

[Tu robot aspirador puede convertirse en espía: consiguen hackearlos para grabar a distancia]

Se trata de un hecho inédito que ha puesto de manifiesto el peligro que puede suponer un mal control sobre la privacidad de las imágenes y sonidos que toman este tipo de dispositivos en los hogares.

Y es que, el problema no habría sido del propio dispositivo, que es de marca Roomba, sino que habría venido desde Scale AI, la empresa que se encarga de etiquetar los datos para entrenar inteligencias artificiales.

Las imágenes privadas tomadas por un aspirador inteligente se filtran en Internet

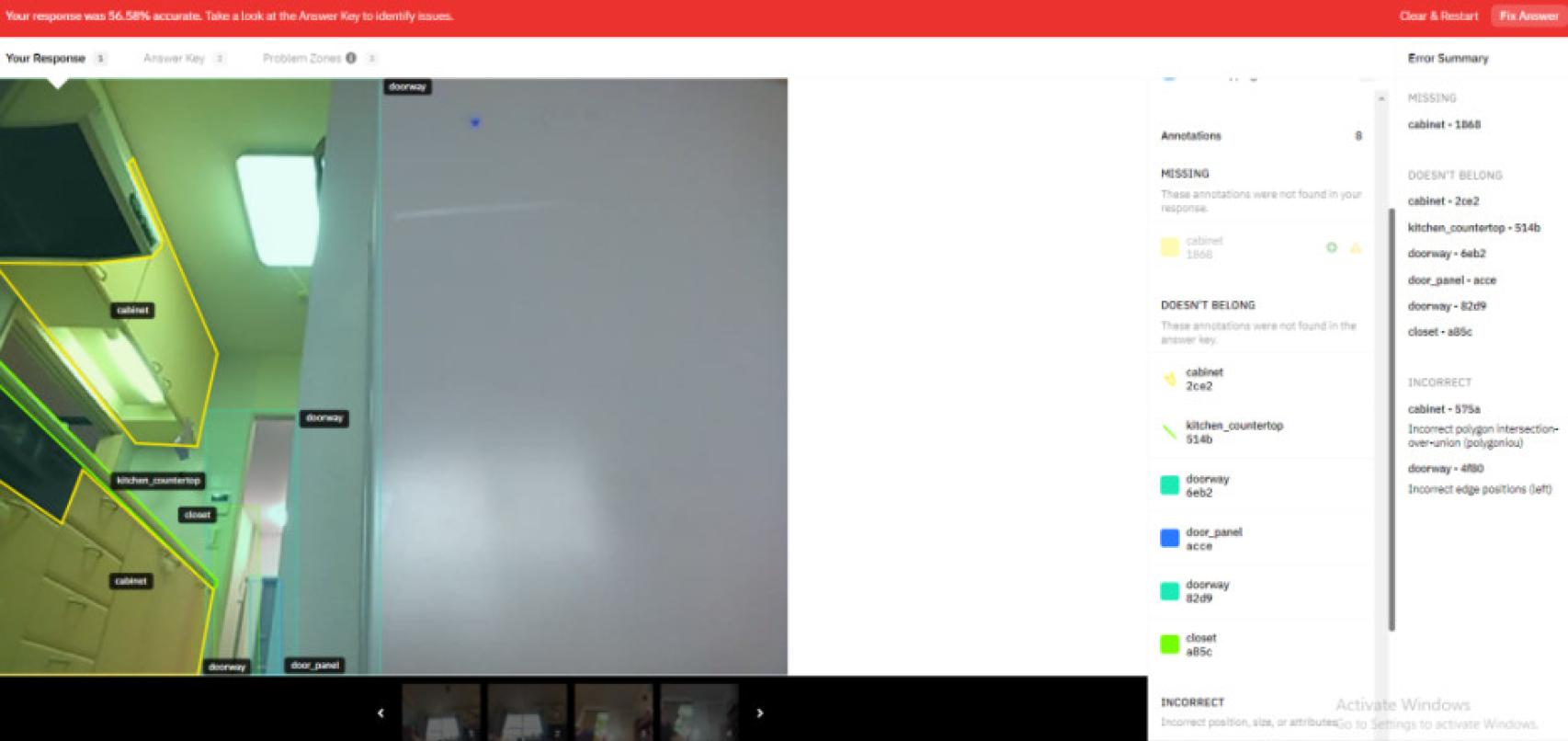

Imagen tomada por aspirador inteligente MIT Technology Review El Androide Libre

Los aspiradores inteligentes suelen llevar sensores y cámaras que les ayudan a moverse, evitar obstáculos y trazar un mapa de tu hogar para crear rutas de limpieza y mucho más, pero para ello, tienen que guardar estas imágenes y entrenar a la IA con estas.

A principios de año MIT Technology Review recibió capturas de fotografías privadas publicadas en grupos privados en redes sociales tomadas por estos dispositivos, una situación sobre la que iRobot declaró que no se trataba de productos finales, sino de prototipos.

Según la compañía, estos tenían una etiqueta con una pegatina verde que avisaba de que estaban grabando, y, tras estas grabaciones, los datos se enviaban a Scale AI para que eliminara las imágenes y vídeos sensibles y que no correspondían con la finalidad de las grabaciones.

No han salido a la luz los acuerdos de consentimiento y tratamiento de datos de ambas empresas, y aunque no se trate de productos finales, sino en pruebas, pone de manifiesto el peligro de este tipo de dispositivos.

Muchos de estos dispositivos inteligentes se basan en el aprendizaje automático y la inteligencia artificial para cumplir sus funciones y mejorar su funcionamiento con el paso del tiempo, pero es importante tener en cuenta que para ello recopilan datos de audio y vídeo que les ayudan a mejorar su algoritmo y a ofrecerte un mejor funcionamiento.

Esto no quiere decir que estos dispositivos sean peligrosos de por sí ni que te vayan a espiar mientras estás en casa, pero es cierto que, al fin y al cabo, se suponía que este tipo de imágenes y vídeos iban a ser descartadas por un equipo humano que revisaba las imágenes, y al final han acabado siendo compartidas en grupos privados de Facebook, algo cuanto menos preocupante.

La responsabilidad en estas situaciones no debe recaer sobre el usuario sino sobre la empresa que trata los datos, que es la que debe asegurar la máxima privacidad para sus clientes.

En este caso, ScaleAI utiliza etiquetadores de datos trabajando en remoto para clasificar las imágenes y hacer aprender al aspirador inteligente basándose en las imágenes que toman.

Sin embargo, es cierto que si tienes miedo de que uno de estos dispositivos pueda grabarte, lo mejor es que no te expongas en ciertas situaciones ante ellos. Aun así, es preocupante que el tratamiento de los datos que toman los dispositivos inteligentes del hogar pueda ser objeto de sustracción.