Un modelo probando el sistema desarrollado por la Universidad de Toronto.

Inteligencia artificial contra reconocimiento facial: la batalla por la privacidad

Investigadores de Toronto diseñan un ‘filtro de privacidad’ para fotos que permite desactivar los sistemas inteligentes de reconocimiento facial.

Noticias relacionadas

Cada vez que subimos una foto a Instagram, o colgamos uno de nuestros videos en Facebook, estamos consintiendo que las redes sociales sepan cada vez más de nosotros. Cedemos parte de nuestra intimidad a favor de algoritmos cada vez más sofisticados que, con nuestros datos, conocen más de nuestros gustos y preferencias que nosotros mismos.

'Vivimos en internet' y no somos del todo conscientes de que hemos cedido ante los software de inteligencia artificial (IA) de las redes sociales. "La privacidad personal es un problema real a medida que el reconocimiento facial se vuelve cada vez mejor", asegura Parham Aarabi, profesor asociado en el departamento de ingeniería eléctrica e informática de la Universidad de Toronto, en Canadá.

Preocupados por la privacidad y la seguridad de los datos en las redes sociales, un equipo de investigadores dirigidos por Aarabi han diseñado un algoritmo capaz de desactivar los sistemas de reconocimiento facial.

Algo así como un 'filtro de privacidad' con el que un algoritmo de inteligencia artificial se enfrente a la inteligencia artificial del sistema automático de reconocimiento facial.

El "entrenamiento contradictorio"

Su solución aprovecha una técnica de aprendizaje profundo llamada "entrenamiento contradictorio". Para conseguirlo diseñaron un sistema de dos redes neuronales: la primera trabaja para identificar rostros, y la segunda para interrumpir la tarea de reconocimiento facial de la primera. Las dos están constantemente luchando y aprendiendo la una de la otra.

El resultado de este 'combate entre inteligencias' es un filtro que puede aplicarse a las fotografías que se suban a las redes para proteger su privacidad.

El nuevo algoritmo altera pixeles muy específicos de la imagen que provoca cambios imperceptibles para el ojo humano que, sin embargo, pueden engañar al sistema de reconocimiento facial.

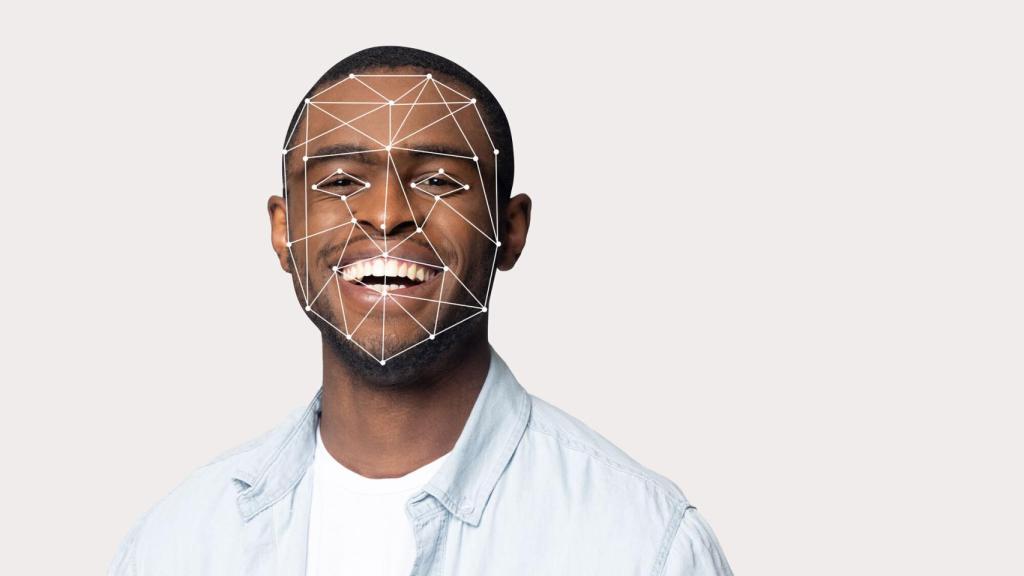

Los puntos nodales de la cara

En concreto, un software de reconocimiento facial identifica una serie de puntos en los rostros – a los que se llama puntos de referencia o puntos nodales – para ‘aprender’ a reconocer una cara.

Por ejemplo, el ancho de la nariz, la distancia entre los ojos o la distancia de la boca al mentón. Todos estos puntos de rasgos faciales forman la huella digital del nuestro rostro que permite a la IA identificar una cara entre las demás.

Como explican los investigadores con este nuevo filtro se consigue "por ejemplo ajustar el rabillo de los ojos para que se noten menos". Engañan así al software de reconocimiento facial "al crear perturbaciones muy sutiles en la foto, pero para el detector son lo suficientemente significativas como para engañar al sistema".

El equipo de Aarabi probó su sistema con una base de datos de imágenes de más de 600 caras de diferentes etnias, en diferentes entornos y con distintos tipos de iluminación.

Con su sistema consiguieron que esos rostros que el reconocimiento facial identificaba en un cien por cien solo pudieran ser reconocidos en un 0,5%. El engaño estaba logrado.