Escáner de resonancia magnética

Esta inteligencia artificial puede leer tu mente y descifrar tus sueños con una simple resonancia

Un equipo de científicos japoneses ha desarrollado un método que consigue extraer las imágenes mentales aplicando la IA de Stable Diffusion.

9 marzo, 2023 16:28Las aplicaciones de la inteligencia artificial llegan hasta los lugares más recónditos del mundo científico. La última: leer el pensamiento y convertirlo en una imagen. Un equipo de científicos japoneses ha creado un sistema para transformar resonancias magnéticas en imágenes empleado Stable Diffusion, una IA muy utilizada en España que crea ilustraciones basándose en descripciones hechas con lenguaje natural.

Según el artículo publicado por la Universidad de Osaka, la reconstrucción de experiencias visuales a partir de la actividad cerebral humana ofrece una forma única de comprender cómo el cerebro representa el mundo e interpreta la conexión entre los modelos de visión por ordenador y nuestro sistema visual.

Antes de la aplicación del nuevo método, otros científicos ya habían aplicado modelos generativos profundos para la misma tarea, pero la reconstrucción de imágenes realistas de alta resolución seguía siendo un problema. Y ahí es donde precisamente entra esta nueva corriente de inteligencia artificial que crea imágenes.

Extraer imágenes cerebrales

La propuesta en la que han estado trabajando los japoneses se basa en las resonancias magnéticas funcionales combinadas con la herramienta Stable Diffusion. Esta inteligencia artificial es capaz de crear imágenes desde cero y a la carta partiendo tan solo de órdenes simples y en lenguaje natural. Con ella se puede crear cualquier tipo de composición y, en general, proporcionará resultados lo más realistas posibles.

Hasta ahora, todos los estudios que se han encaminado a la extracción de imágenes a partir de resonancias magnéticas cerebrales se han topado con señales con mucho ruido y muy variables entre individuos. "Además, la relación entre la actividad cerebral y la percepción visual es compleja y no lineal", según indica John Nosta, fundador del think tank Nostalab especializado en salud digital.

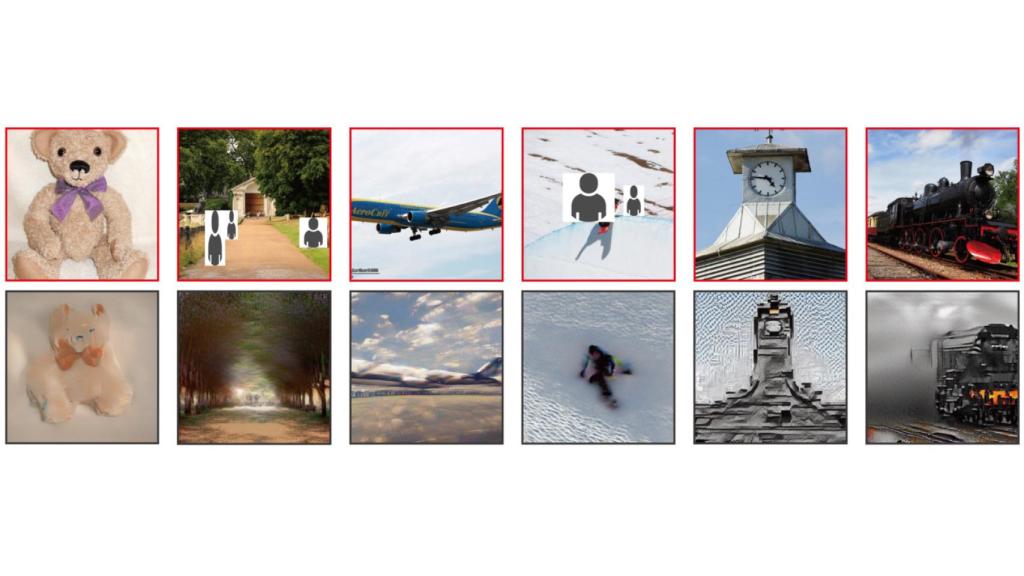

En la fila superior, imágenes que se mostraron a los participantes. En la inferior, resultados extraídos con resonancia e IA

El método de la Universidad de Osaka recurre al modelo de difusión latente, que basa su funcionamiento en el entrenamiento de redes neuronales para eliminar el ruido gaussiano de las imágenes borrosas. Un sistema que emplean algunas de las herramientas —como DALL-E o la propia Stable Diffusion— de creación de imágenes con inteligencia artificial.

Esto permite a los investigadores estimar la imagen visual subyacente que da lugar a las señales de las resonancias magnéticas obtenidas de los humanos. La mecánica comienza con los participantes viendo una serie de imágenes al mismo tiempo que se les realiza una resonancia cerebral.

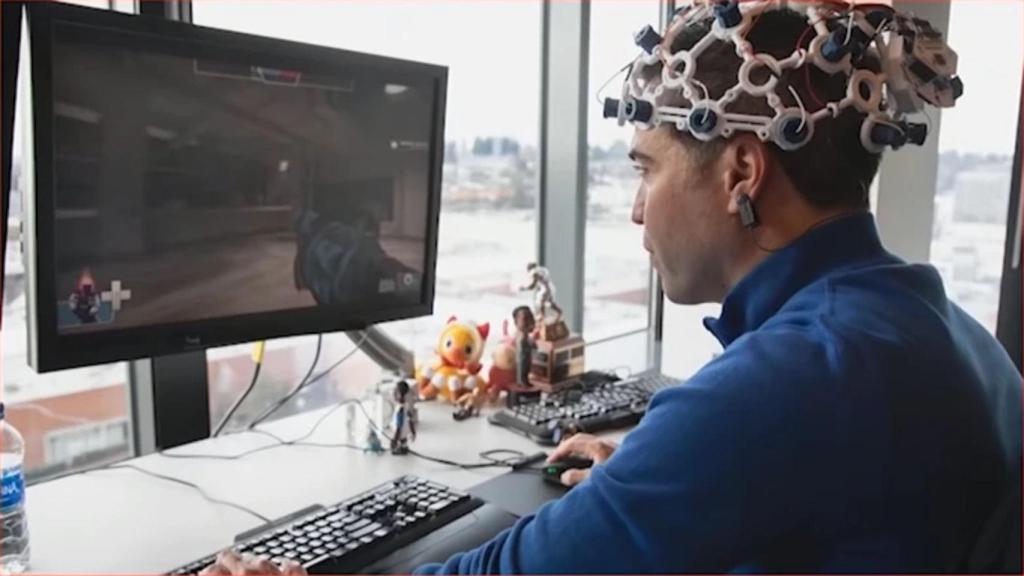

Un investigador juega con un dispositivo de interfaz cerebro-máquina Omicrono

Esa información se somete a un primer procesado para eliminar el ruido y, posteriormente, se extraen las imágenes usando el algoritmo de aprendizaje automático. Así han sido capaces de pasar de señales cerebrales como los cambios en el flujo sanguíneo y la oxigenación a una imagen que puede verse una pantalla.

El proceso de difusión —mediante la aplicación de Stable Diffusion— permite a los investigadores suavizar el ruido y otras variaciones de las señales obtenidas mediante la resonancia. Al mismo tiempo que preserva la estructura y el contenido de la imagen visual que el participante en el experimento tiene en su cabeza.

[El escáner cerebral para decodificar pensamientos: así leerá la mente sin necesidad de implantes]

"Esto es importante porque asegura que la imagen reconstruida sea fiel a la actividad cerebral observada y visualmente plausible", comenta Nosta. "No es una tarea fácil".

En las conclusiones del estudio presentado, los científicos japoneses indican que "el método puede reconstruir imágenes de alta resolución con alta fidelidad semántica de la actividad cerebral humana". La gran diferencia respecto a otras investigaciones es que este método no requiere entrenamiento o ajuste de modelos complejos de aprendizaje profundo, sino que emplea los ya disponibles.

Aplicaciones

Más allá de leer la mente y transformarlo en imágenes, la aplicación de este nuevo método puede traer beneficios en algunas áreas clave de la salud. Principalmente en todo lo que rodea a la investigación neurocientífica, como el estudio de imágenes visuales, imágenes mentales y sueños, explica Nosta.

Del mismo modo, también puede tener aplicaciones prácticas en entornos clínicos, como en el desarrollo de interfaces cerebro-computadora para personas con parálisis y otras deficiencias motoras. Al comprender cómo se puede traducir en imágenes una resonancia, según Nosta, esto puede abrir un canal bidireccional de información.

Un mono jugando al Pong con la mente. Omicrono

Algo en lo que se alinea la tecnología Neuralink de Elon Musk, que pretende comunicarse directamente con el cerebro humano para enviar imágenes o sonidos. "El futuro del sonido y las imágenes puede redefinirse y reinventarse por completo al eliminar el componente vibratorio de la luz y los sonidos".

Tal y como la digitalización —casi— terminó con los vinilos y las cintas, Stable Diffusion y las resonancias magnéticas "pueden cambiar de manera fundamental la forma en la que experimentamos las imágenes".