Fotomontaje con el logo de OpenAI. Omicrono | iStock

Granjas de clics hechas con inteligencia artificial: webs falsas que te inundan con desinformación

Se están generando todo tipo de granjas de clics automatizados que intentan rascar ingresos por publicidad de prácticamente donde sea.

2 mayo, 2023 18:42Una de las principales preocupaciones que ha llevado a los expertos en IA como Geoffrey Hinton a temer esta tecnología es el mal uso que algunos le pueden dar a la misma. En España ya hemos visto ejemplos como los deepfakes, vídeos e imágenes hechos con inteligencia artificial que usualmente se usan con motivos políticos. Según recoge el sitio de calificación de webs NewsGuard, los usuarios están dándole un nuevo uso a estas IAs: crear sitios y publicaciones en webs falsos para generar las clásicas granjas de contenido.

En definitiva, sitios de spam. La idea es que gracias a la tracción en Internet, estos sitios puedan generar ingresos publicitarios de clics de usuarios. Algo que ya se estaba haciendo pero en un proceso muchísimo más manual y laborioso, lo que ha llevado a muchos a usar IAs para crear estas webs. Y es que la adopción de herramientas como ChatGPT ha abierto las puertas a la creación de estos sitios.

NewsGuard explica que se han identificado hasta 49 páginas que parecen "estar escritas casi en su totalidad por software de inteligencia artificial". Webs que intentan pasar lo justo desapercibidas para que no sean objetivo de los controles de Google pero que pueden generar una gran cantidad de contenido de forma automática, llegando a cientos de publicaciones al día.

Sitios de spam con IA

Según NewsGuard, esta clase de sitios "no revelan la propiedad o el control" de sus contenidos por motivos evidentes. La temática de las publicaciones da exactamente igual; tocan "política, salud, entretenimiento, finanzas y tecnología". Lógicamente muchos de estos contenidos provienen de bases de datos que recogen artículos ya escritos de medios prestigiosos, lo que resulta en traducciones poco elaboradas de esos mismos artículos.

Salvando esas reproducciones, NewsGuard detalla cómo buena parte del contenido que allí se refleja directamente es falso. "Casi todo el contenido presenta un lenguaje suave y frases repetitivas, características de la inteligencia artificial". A eso se le suman nombres genéricos (Biz Breaking News, Market News Report) que están ahogados en publicidad. De nuevo, la mayoría son reproducciones o resúmenes de artículos de medios internacionales, como el The New York Times o la BBC.

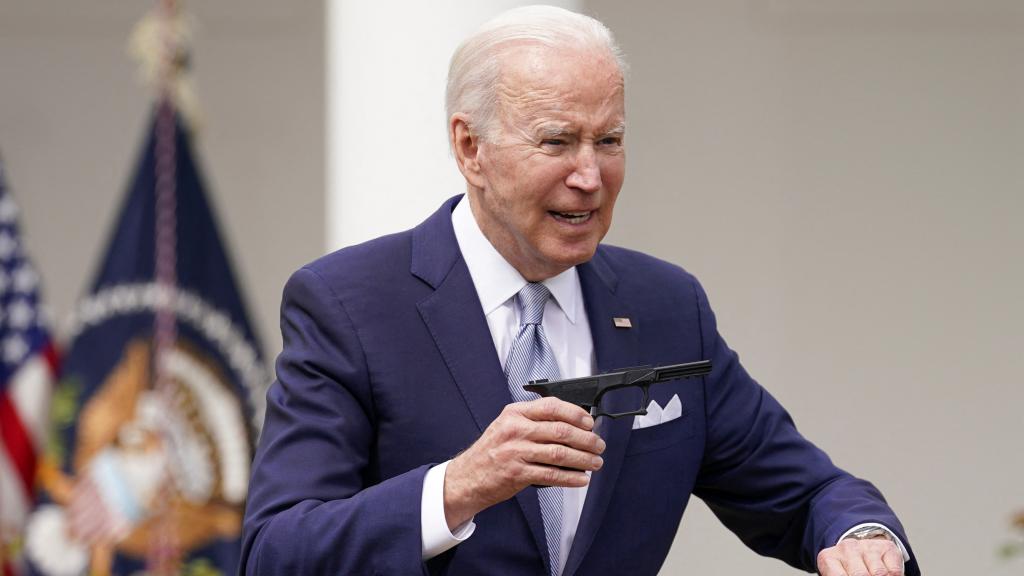

Biden sostiene un arma impresa en 3D Omicrono

El que mucho de este contenido no sea falso tiene dos explicaciones. La primera es que son reproducciones de historias verdaderas con investigación detrás y la segunda es que el contenido directamente falso tarda menos en ser eliminado en caso de ser detectado. No obstante, esto no ha evitado que estas webs proliferen.

Un ejemplo es la web ya extinta CelebritiesDeaths, que recogía una noticia falsa sobre cómo Joe Biden, actual presidente de los Estados Unidos, había fallecido, según recoge The Verge. Este caso es especialmente flagrante, ya que los párrafos siguientes incluían directamente un mensaje de error del chatbot que generó dicho mensaje, y los responsables del sitio no dudaron en pegarlo sin más. El mensaje de error afirmaba que no era ético "fabricar noticias sobre la muerte de alguien".

Mensaje copiado directamente del chatbot. NewsGuard

Además de los errores de traducción y gramática existente en estos artículos, existen herramientas directas que permiten verificar cuándo un texto es generado por IA. Es el caso de GPTZero, que sobre el papel es capaz de detectar texto generado por un chatbot, y sirvió para que NewsGuard pudiera hallar muchos de los problemas de estas webs.

El aumento de la accesibilidad en estos chatbots y sobre todo la popularización de las herramientas de IA generativa podrían hacer que las predicciones de muchos de estos expertos se hagan realidad: una era de desinformación en la que el usuario no pueda verificar qué es real y qué no. Una expansión de estos problemas podría obligar a los gobiernos de todo el mundo a tomar medidas para regular el uso de estas tecnologías.