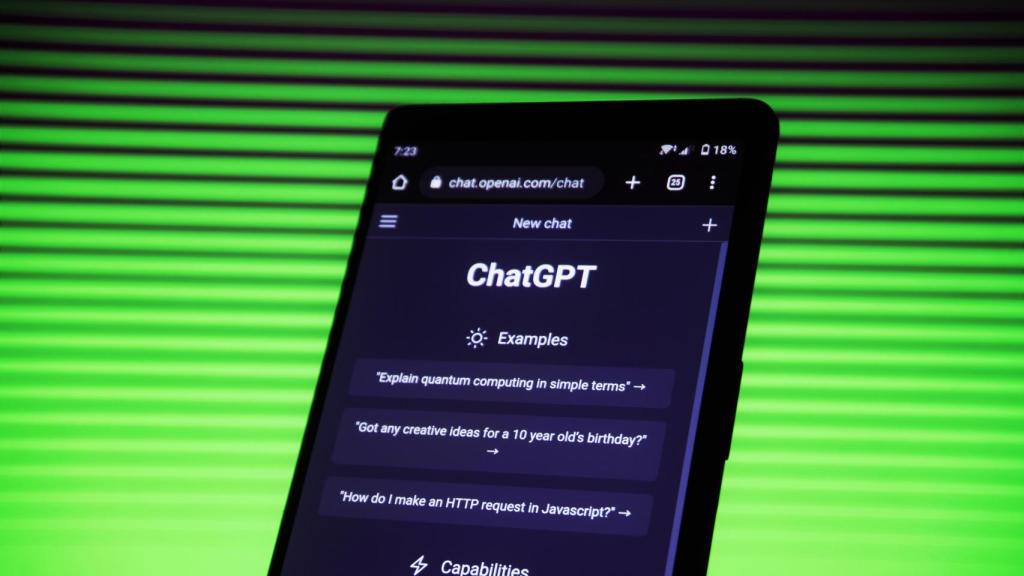

Una imagen de archivo de ChatGPT.

Los políticos no podrán utilizar ChatGPT: OpenAI prohíbe el uso de su IA en campañas electorales

La compañía ha tomado esta medida para "prevenir abusos" y brindar transparencia en las elecciones que se realizarán este año en todo el mundo.

OpenAI ha comenzado el año realizando una serie de cambios importantes con respecto a ChatGPT, su sistema de chat basado en el modelo de lenguaje por inteligencia artificial (IA). Si recientemente la compañía liderada por Sam Altman lanzó GPT Store, la tienda donde comprar chatbots personalizados o levantó el veto a que su IA se pueda utilizar para fines militares; ahora ha indicado la prohibición de que los políticos usen su tecnología en las campañas electorales.

2024 se presenta como un año repleto de procesos electorales en países especialmente importantes desde el punto de vista internacional, como son Estados Unidos, India, Rusia o México, entre otros. Incluso el propio Parlamento Europeo va a convocar elecciones este año. Con el objetivo de que la inteligencia artificial como ChatGPT se utilice para realizar campañas electorales, OpenAI ha anunciado la prohibición de su tecnología para este fin con el objetivo de "prevenir abusos" y brindar transparencia.

"Nuestro enfoque es continuar nuestro trabajo de seguridad de la plataforma, elevando información electoral precisa, aplicando políticas mesuradas y mejorando la transparencia. Estamos trabajando para prevenir abusos, brindar transparencia en el contenido generado por IA y mejorar el acceso a información de votación precisa", ha explicado OpenAI en un comunicado oficial.

ChatGPT Omicrono

La compañía también ha explicado que no permitirá la creación de chatbots que se hagan pasar por candidatos o por instituciones gubernamentales: "no permitiremos que la gente cree aplicaciones para campañas políticas y lobby. Trabajamos para anticipar y prevenir abusos relevantes, como deepfakes engañosos, operaciones de influencia a escala o chatbots que se hacen pasar por candidatos".

Además, la empresa ha recordado que DALL-E, su herramienta de generación de imágenes, cuenta con barreras de seguridad para evitar la creación de contenido sobre políticos y personas reales. No sólo eso, sino que también está probando una herramienta llamada "clasificador de procedencia", que permitirá a periodistas e investigadores detectar si una imagen fue generada por inteligencia artificial durante las elecciones.

[Aprueban una ley redactada por ChatGPT en secreto: la última polémica por usar la IA en política]

Por otro lado, OpenAI ha asegurado que seguirán integrando la plataforma de ChatGPT con informes de noticias en tiempo real a nivel mundial. "La transparencia en torno al origen de la información y el equilibrio en las fuentes de noticias pueden ayudar a los votantes a evaluar mejor la información y decidir por sí mismos en qué pueden confiar", han indicado.

También te puede interesar...

- El único empleo que no se perderá por la inteligencia artificial, según el fundador de ChatGPT

- El sencillo truco para hackear ChatGPT que revela miles de teléfonos y emails privados

- Todas las novedades del nuevo ChatGPT: más rápido, versátil y con chatbots especializados

- ¿ChatGPT es de izquierdas? Desvelan las tendencias políticas de las inteligencias artificiales