Manoj Tiwari, político indio que ha usado los llamados 'deepfakes'.

Los vídeos falsos hechos con IA ya se han colado en la política: por qué debes tener cuidado

Los vídeos falsos hechos con IA ya han llegado a la política, en especial a las elecciones indias. ¿Por qué deberías ser cauteloso?

Noticias relacionadas

Una de las grandes preocupaciones de nuestro tiempo es el poder de la Inteligencia Artificial y su cuestionable uso ético que se le está dando en algunos campos. Exacto: hablamos de los vídeos falsos hechos con IA, o también conocidos como 'deepfakes'. Estos vídeos se basan en esta tecnología para generar vídeos falsos realistas, que parezcan auténticos, ya sea en clave de sátira o para atentar contra adversarios políticos.

Pero son una preocupación precisaemnte por su poder; estos vídeos pueden ser extremadamente realistas si se hacen de forma correcta, y más importante aún, se comparten en una Internet caracterizada por la desinformación y las 'Fake News'. Una Internet que se cree lo primero que lee en una red social; detalle que los ciberdelincuentes saben aprovechar a su favor. Y estos 'deepfakes' ya se han colado en la política.

Concretamente, en la política de La India; un político del país ha usado Inteligencia Artificial para traducir su discurso a otros idiomas. Una maniobra, aparentemente, inocente, pero que abre varios frentes no muy halagüeños.

La India estrena los 'deepfakes'

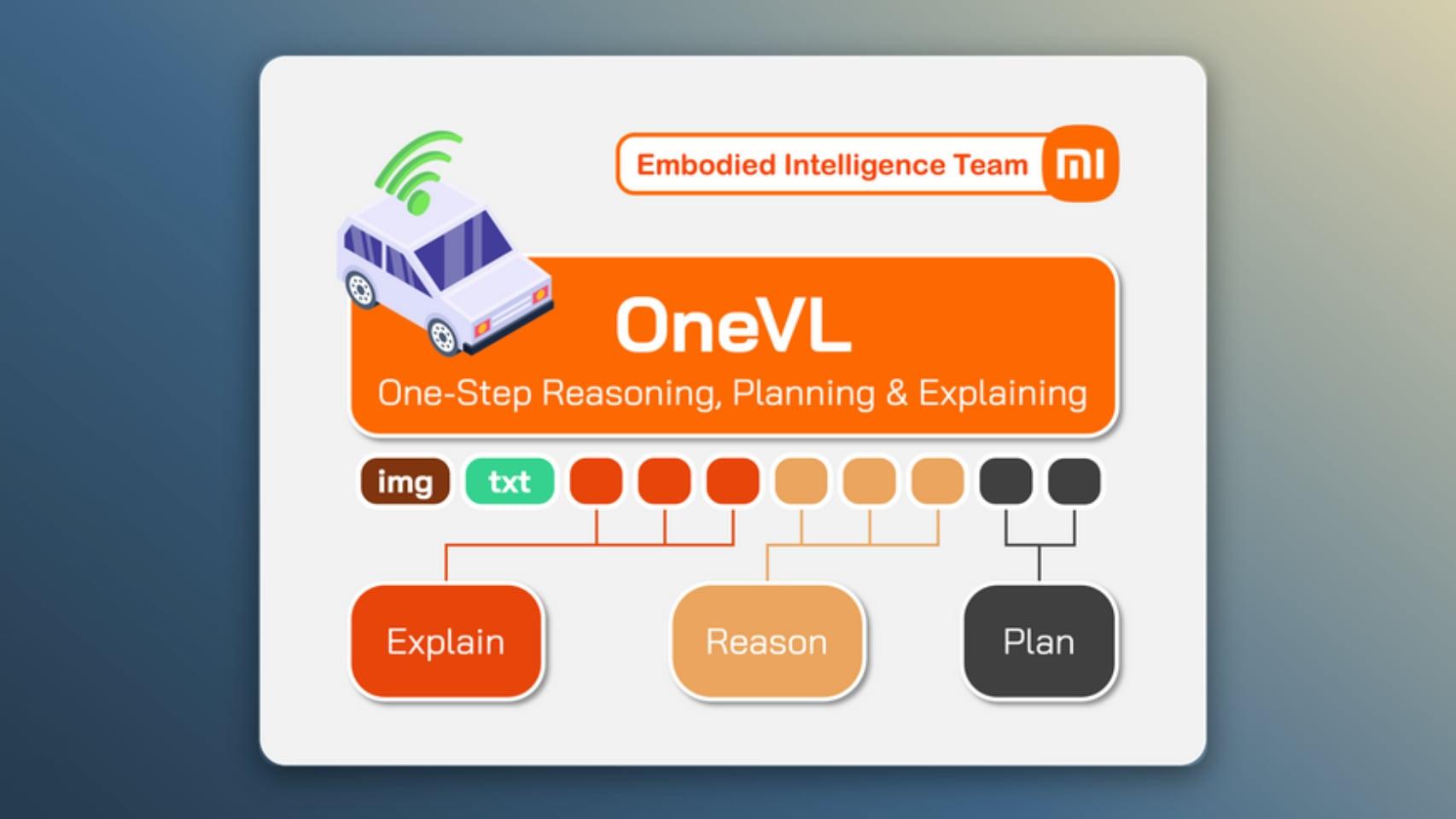

En este vídeo podemos ver a Manoj Tiwari, un político hindi que según reporta Vice ha usado esta IA para falsificar el cómo se expresa en diferentes idiomas. En varios vídeos se puede ver al mismo Tiwari hablar en varios idiomas, entre ellos en inglés y en dialecto hindi. La firma de comunicaciones políticas 'The Ideaz Factory' explicó que estaba trabajando con el Patido Bharatiya Janata de Tiwari para crear "campalas positivas" usando esta tecnología con fines más positivos.

"Usamos un algoritmo de falsificación usado en los 'deepfakes' de sincronización de labios. Lo entrenamos con discursos de Manoj Tiwari para traducir con un doblador los sonidos de audio en formas báiscas de la boca", según explica Sagar Vishnoi, de la firma. Agregó que esto le permitió apuntar a votantes que, de lo contrario, no podría haber alcanzado solo. Esto es debido a que aunque los 2 idiomas oficiales de La India son el hindi y el inglés, algunos estados del país tienen sus propios dialectos.

Según Vice, el vídeo llegó a unas 15 millones de personas. Y es cierto que se usa en un contexto mucho más positivo, ya que los 'deepfakes' son usados, principalmente, en pornografía y en ataques políticos. Pero, de nuevo, este hecho abre la puerta a lecturas algo inquietantes.

Un 'deepfake'... ¿inocente?

No está claro si Tiwari, de no ser por la investigación de Vice, habría dicho claramente que estos vídeos están hechos con IA. ¿Habría sido honesto, o hubiera dado a entender a estas 15 millones de personas que él sabe hablar dialectos que no sabe hablar? Por mucho que sea una inocente mentira, no dejan de ser mentiras al fin y al cabo. Mentiras que, en última instancia, pueden ayudar a decantar la balanza en unas elecciones.

Equipo E (deepfake)

Por otra parte, ¿qué se define como un uso 'correcto' de los 'deepfakes'? ¿Está bien usarlos para realizar promoción política, incluso cuándo se está usando esencialmente la mentira? El que estas tácticas ya se estén usando en la política estandarizada de un país deja la puerta abierta a que un país que no tenga una regulación clara al respecto los estandarice; otros políticos podrían usar estas mismas tácticas, de nuevo, alegando razones menos nocivas que el porno pero de nuevo mintiendo a millones de personas.

De hecho, la excusa es bastante llamativa; ¿usar un 'deepfake' sólo porque no sabes hablar un idioma para ciertos votantes? Un candidato que supuestamente maneje más idiomas podría ser visto con mejores ojos dependiendo del votante medio que vea el vídeo y se lo crea; el votante es influenciable, y sin la información del 'deepfake' de por medio puede llegar a una conclusión muy favorable para el candidato, en este caso, de La India.

Ya se están dando pasos para evitarlo

En el año 2018 se publicaron varios 'deepfakes' del presidente Obama que planteó preocupaciones serias acerca de cómo estos vídeos se podían introducir en la clase política estadounidense. En mayo del año pasado, se publicaron todavía más 'deepfakes' atacando al bloque demócrata de Estados Unidos, esta vez con un famoso vídeo que mostraba a la Presidenta de la Cámara de Representantes de EE.UU, Nancy Pelosi, como si estuviera borracha.

El Estado de California fue de los primeros en aprobar un proyecto de ley que hacía ilegal compartir 'deepfakes' de políticos en un período de 60 días dentro de elecciones. En enero, el Comité de Ética de la Cámara informó a los diputados que el publicar este tipo de vídeos en sus redes sociales podría considerarse una violación de las reglas de la Cámara.

Redes sociales.

No solo las clases políticas; empresas como Twitter ya han anunciado la prohición de estos 'deepfakes' en su red social y Facebook, harta de las críticas que le cayeron por negarse a borrar el 'deepfake' de Pelosi, anunció que prohibiría la entrada de estos vídeos. Reddit hizo lo propio, asegurando que su política para prohibir toda suplantación en la plataforma que incluye, precisamente, a estos 'deepfakes' se establezca.

Es vital que siempre que veas vídeos de esta clase, recurras a organismos de investigación y de verificación para confirmar que estos vídeos son falsos. Es importante que no te creas prácticamente nada de lo que no llega de medios oficiales, y que siempre recurras a canales de información oficiales que cuenten con fuentes contrastadas. Cuando recibas información de canales como redes sociales, encárgate de verificarla y buscar información por medios como estos organismos o la misma prensa y contrasta tú mismo la información.