Gemini Live en un móvil de gama media El Androide Libre

He probado el futuro de la inteligencia artificial en un móvil bastante normal y el resultado es espectacular

Gemini está dando acceso a los usuarios a la función de visión por cámara, lo que cambia la manera en la que interactuamos con la IA.

Más información: He probado Gemini Advanced, la inteligencia artificial de pago de Google con experiencias sobresalientes

La inteligencia artificial está cambiando cómo se hacen las cosas en multitud de países, entre los que está España. ChatGPT ha permeado ya en la sociedad a nivel personal, laboral y estudiantil a unos niveles que no hubiéramos esperado hace solo dos años. Desde usuarios que intentan usar la IA para estudiar menos, a otros que se suman a las tendencias de moda.

Pero esta tendencia no es exclusiva de Open AI, y empresas como Amazon o Google han realizado fuertes apuestas. La compañía fundada por Jeff Bezos ha presentado recientemente Alexa+, aunque limitada con respecto a lo que mostraron hace un año. Pero ha sido Google la que más está avanzando. No en vano inventaron la tecnología que ha desatado toda esta fiebre, los transformers.

Con Gemini, la empresa de Mountain View ha conseguido liderar en varios apartados, desde la creación de vídeo con Veo 2 a la de generación de imágenes, por no hablar de la fortísima integración de Gemini tanto con Android como con sus aplicaciones. Y es ahí, en la integración con nuestros móviles donde Google tiene una enorme ventaja.

Gracias a que la mayoría de la IA se procesa en la nube, no es necesario contar con móviles con un procesador muy potente e ingentes cantidades de memoria. Para algunas cosas ayuda, como vimos en el análisis del Samsung Galaxy S25 Ultra, pero Google no quiere limitar el uso de su chatbot.

Es por ello que hace unas semanas anunció que una de las funciones más impresionantes de Gemini Live estaría disponible en muchos móviles Android, no sólo en los más potentes. Nos referimos a la opción de Compartir Pantalla, que es como se ha denominado lo que se anunció en el Google I/O 2024 como Project Astra. Ahora esta función está disponible para cualquier usuario en España que tenga contratado Gemini Advanced, la versión más potente del sistema de Google.

Es mirar al futuro

La velocidad a la que evoluciona esta tecnología no es normal. Y eso que en el sector de los smartphones y la informática estamos acostumbrados a unos cambios casi consecutivos anualmente. Pero es que con la IA parece que todo queda anticuado en meses, y no hablamos de tendencias corporativas o de funciones que sólo se vean en grandes empresas, sino de funciones que cualquiera pueda usar.

En este caso Google ha logrado hacer un producto comercial de una tecnología que mostró por primera vez hace menos de un año y que pocos creían que podrían usar en breve. Ahora está disponible en muchos países, entre los que está España. Para usarla simplemente hay que dejar pulsado el botón de encendido en un móvil que tenga Gemini y activar el asistente. Lo hemos probado en un Motorola Edge 60 Fusion, un móvil que cuesta poco más de 300 euros.

Gemini Live y Libros

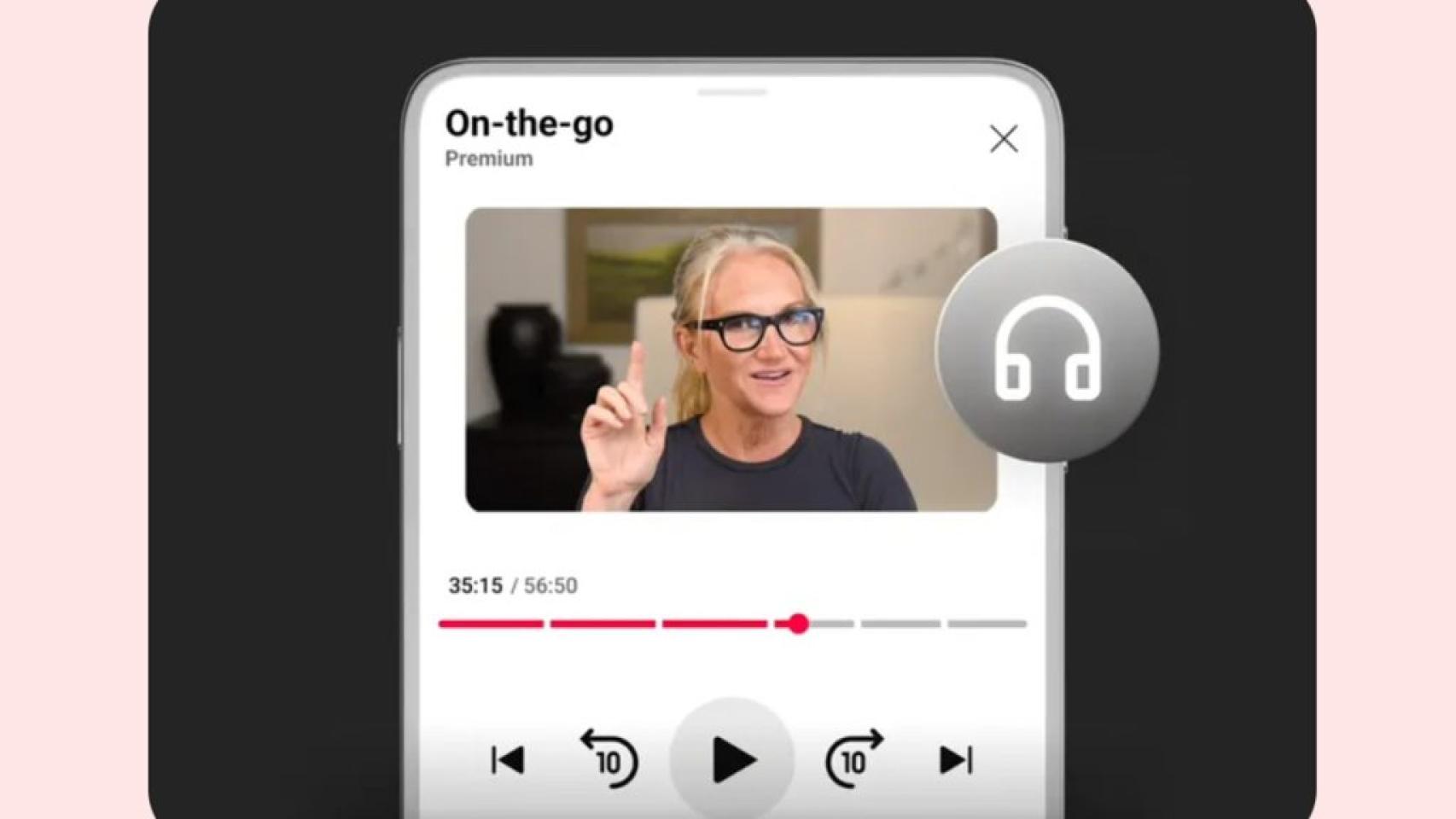

Aparecerá un nuevo botón con el texto "Compartir pantalla con Live" y al pulsarlo la app se minimizará y mostrará un destello en el perímetro, para que sepas que está grabando en segundo plano lo que muestra el móvil. Es posible realizar preguntas directamente sobre lo que aparece en pantalla, sea el escritorio del móvil o cualquier aplicación.

Por ejemplo, podríamos pedirle consejo sobre cómo responder a un mensaje de WhatsApp que nos haya llegado y nos haya descolocado un poco. O podemos pedirle consejo sobre un producto que tengamos en la cesta de la compra de una tienda online. Obviamente, podemos hablar con el sistema sin tener que compartir la pantalla, pero eso es posible con cualquier cuenta de Google, no hace falta tener la tarifa avanzada de Google One.

Gemini Live y altavoces

Lo más espectacular empieza cuando abrimos la app de cámara con Gemini Live en segundo plano. Ahí podemos preguntarle igualmente por lo que ve, que es lo que nosotros estemos apuntando con la cámara. En los vídeos que hay en este mismo artículo podéis comprobar la velocidad de la respuesta y cómo el sistema puede responder a nuestras dudas, podemos interrumpirlo, etc.

En ocasiones no llega a poder responder bien porque lo que le mostramos no se aprecia bien, por las sombras, porque no tiene una forma lo suficientemente definida, pero si insistimos y vamos moviendo la cámara la mayoría de veces nos da una respuesta satisfactoria. Esto es algo que suponemos irá mejorando con el tiempo, a medida que el reconocimiento de imágenes de Google, que ya se usa en otras aplicaciones como Google Lens, vaya mejorando.

Por ahora, solo de pago

Una de las mayores limitaciones de esta tecnología es su costoso procesamiento. Que una IA genere una imagen es caro, que sea capaz de entender en tiempo real lo que ve, mediante el análisis de imágenes, lo es más. Y eso hay que sumarlo a las preguntas que le hacemos, mediante síntesis de voz, que nos responde en milisegundos.

Todo esto es impresionante de ver en acción, y lo será aún más cuando podamos usarlo en gafas de realidad aumentada, como en las que están trabajando Samsung y Google, por ejemplo. Pero es caro de procesar, al menos por el momento. Es por eso que para poder usarlo hemos de tener una de las tarifas más caras de Google One.

Gemini Live y un cable de datos

Se trata de Google One AI Premium, la tarifa que cuesta 21,99 euros al mes. Las hay incluso más caras, pero solo cambian en la cantidad de GB de almacenamiento en la nube de los que dispondremos. En este caso, la versión menos costosa que incluye Gemini Advanced es la de ese precio, y además de ese acceso tendremos 2 TB en la nube de la empresa (a compartir entre Gmail, Google Fotos, Drive...), Gemini en apps como Gmail o Google Docs, Notebook LM+ y el resto de ventajas del plan premium.