El investigador Marcelo Bertalmío del Instituto de Óptica (CSIC). Fundación BBVA

Bertalmío, el experto en imagen digital del CSIC y cineasta que revoluciona la IA enseñándola a ver

"Es peligroso pensar que las redes neuronales pueden resolver todos los problemas"/"Un pato interpreta la información visual más eficientemente que una IA"/"Los investigadores necesitamos que nos quiten trabas".

25 marzo, 2024 01:25Es difícil encontrar perfiles tan eclécticos, renacentistas incluso, como los del español Marcelo Bertalmío. Nacido en Montevideo en 1972 y doctorado en Ingeniería Eléctrica e Informática por la Universidad de Minnesota, fue catedrático en la Universidad Pompeu Fabra antes de saltar al grupo de investigación en Ciencias de la Imagen y la Visión del Instituto de Óptica del CSIC. Junto a méritos como el premio ICREA Academia y figurar en la Lista Stanford del 2% de los científicos más citados del mundo, también es director de cine con dos largometrajes.

Junto con Jesús Malo López (Universitat de València) y Felix Wichmann (Universidad de Tubinga, Alemania), Bertalmío lidera el proyecto VIS4NN, uno de los cinco ganadores de la convocatoria del 'Programa Fundamentos' de la Fundación BBVA en apoyo de la ciencia básica. Trabajarán en redes neuronales que eviten que la Inteligencia Artificial siga cometiendo errores al interpretar la información visual, como dejar de entender una señal de Stop porque alguien le haya puesto una pegatina o no distinga una silla de un elefante si el encuadre de la foto no es el adecuado.

Su proyecto hace frente a una carencia sorprendente de la IA. ¿Cómo es posible que, pese a los avances, confunda una silla volcada con un elefante?

El éxito tremebundo de la Inteligencia Artificial ha sido propulsado por un tipo de tecnología llamada 'redes neuronales'. Tienen habilidades realmente impresionantes, pero también limitaciones, tres de ellas 'críticas', que son aquellas para las que no se vislumbran soluciones. La primera limitación crítica es la capacidad de generalización: las redes neuronales tienen un rendimiento asombroso cuando usan datos similares a los que conoce, pero fallan estrepitosamente si difieren. Una red entrenada para clasificar una silla la reconocerá si está centrada y bien iluminada, pero si está rotada o en mitad de un desierto, no lo hará. Es un fallo que los humanos no cometemos.

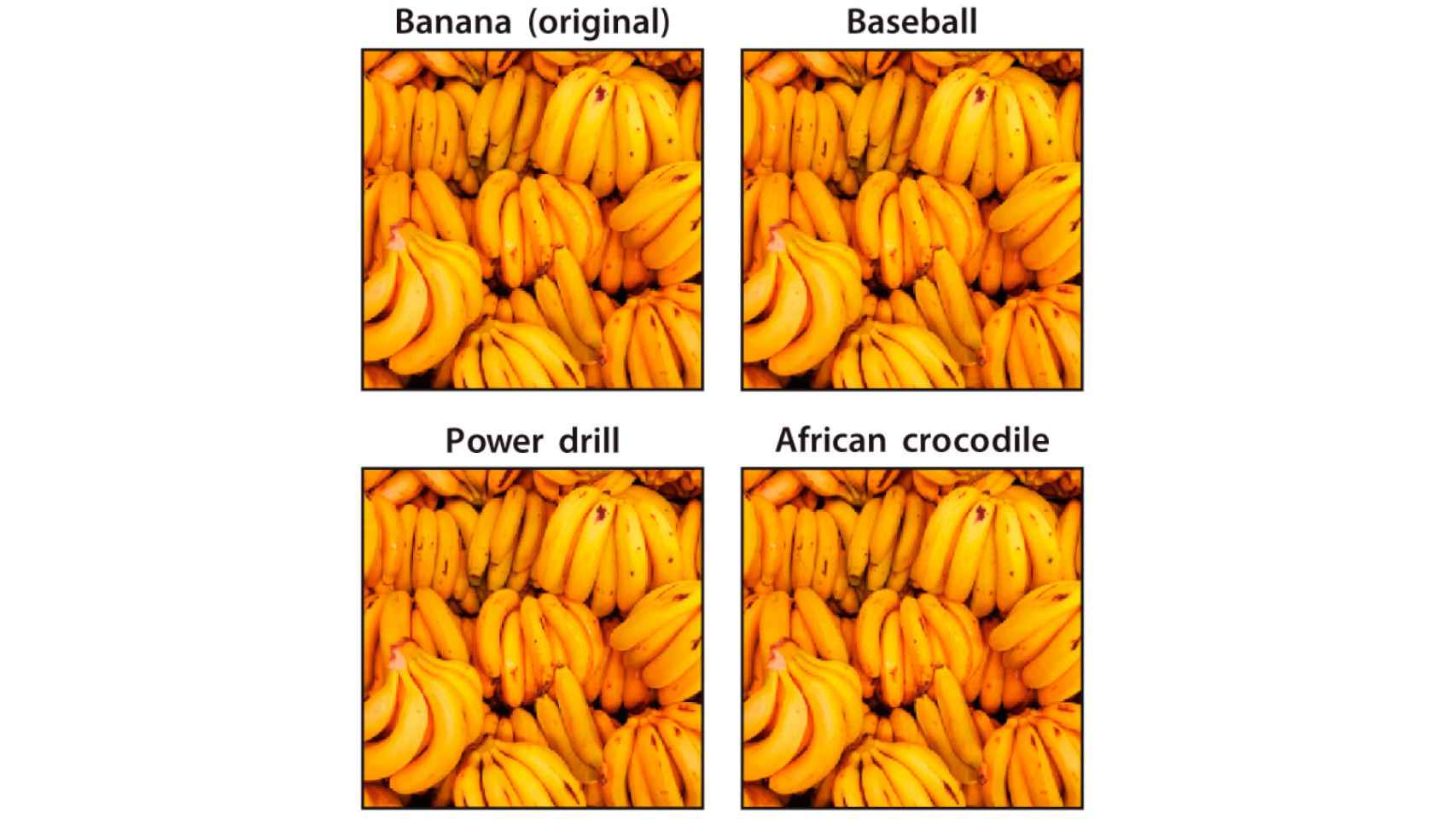

Hay otro ejemplo asombroso: un simple cambio de un píxel, imperceptible para nosotros, hace que la IA pase de ver un 'plátano' a ver un 'cocodrilo'.

Es la segunda limitación crítica, son susceptibles a los 'ataques adversarios': pequeñas perturbaciones de la entrada que se suelen hacer de manera maliciosa. Provocan una respuesta errónea con mucha seguridad. Nosotros no lo vemos, pero hay algo en esa imagen que está perturbando el reconocimiento a la red. Tú ves cuatro veces la misma imagen de unos plátanos, pero la red te dice que es un cocodrilo y también un taladro con una confianza cercana al 100%. También puede pasar con texto: demostraron que, en una red neuronal que hace diagnósticos clínicos, usar una palabra o su sinónimo pasa de un resultado positivo a considerarte, por ejemplo, alcohólico.

Las diferencias imperceptibles al ojo humano que confunden a la red neuronal.

Ha mencionado tres limitaciones críticas, ¿cuál sería la tercera?

La última limitación crítica para la cual no se encuentran aún soluciones eficaces es la cantidad descomunal de datos de entrenamiento que necesitan las redes. No sólo requieren mucha más información para aprender sino también para ejecutarse y hacer operaciones. Esto conlleva un consumo energético increíble. Hemos calculado que, para lograr que tengan menos del 5% de error en el reconocimiento de objetos, la emisión de CO2 sería la misma que genera la ciudad de Nueva York en un mes. Y estas tres limitaciones críticas son fallos de las redes neuronales al emular la visión humana.

¿Cuáles son los obstáculos a los que se enfrentan los sistemas de visión artificial frente a la biológica?

Su inspiración viene de modelos neuronales que se establecieron entre los años 50 y 70. Se sabía que eran versiones simplificadas de las neuronas biológicas, pero se tenía fe en que no se perdiera nada por el camino. Ahora sabemos que esa noción era errónea. Al configurar las redes neuronales, se han dejado de lado propiedades fundamentales de las neuronas biológicas que determinan la visión. Para nuestro proyecto usamos conocimientos de neurociencia y percepción visual para desarrollar un nuevo tipo de redes neuronales artificiales que no tengan estas limitaciones críticas.

No es una facultad únicamente humana: ha llegado a decir que "un pato" interpreta más eficientemente la información visual que una IA.

Sí, son ejemplos muy llamativos. Un pato, a los dos días de vida, puede determinar si dos objetos son iguales o no. Para que una red neuronal pueda hacer lo mismo necesitas muchísimos datos, y fallan sistemáticamente cuando usas objetos diferentes a los empleados en el entrenamiento. Da la impresión de que saben hacer cosas, pero en realidad han tenido que memorizar millones de millones de parámetros.

¿Carecen de nuestra capacidad innata de agrupar semánticamente? Si vemos una silla extrañamente diseñada, sabemos que es un mueble, no un animal.

Así es. Incluso un insecto posee una gran flexibilidad en sus neuronas. Son esenciales: proporcionan ahorro de energía y una capacidad de adaptación en cuestión de milisegundos. Pero estas propiedades biológicas han sido sistemáticamente ignoradas en los modelos que usan las redes artificiales. Y emularlas conlleva una enorme complejidad.

¿La desventaja de las redes es que no están presentes, por así decirlo, en el mundo real? ¿No interactúan cazando, transformando la naturaleza...?

Sí, es una buena forma de plantearlo. Tenemos el Teorema de Aproximación Universal, que viene a decir que una red neuronal es capaz de realizar con mucha fiabilidad cualquier función matemática que cumpla una serie muy pequeña de requisitos. Eso ha dado una falsa sensación de seguridad: creer que cualquier problema puede resolverse con estas redes. Y si no, hay que poner más neuronas. Es una idea peligrosa, porque termina introduciendo inestabilidad. La única solución serían las redes dinámicas, que cambiasen y se reconfiguraran adaptándose dependiendo de la entrada de datos.

Jesús Malo López y Felix Wichmann, los dos otros investigadores principales. Fundación BBVA

Una manifestación imprevisible de la IA es la del arte, cuando le pedimos ilustraciones en base a conceptos. Como investigador y creador, ¿cómo lo ve?

Yo no soy ningún neoludita, un talibán en contra de las tecnología. Lo que logra la generación de imágenes ahora es muy interesante tanto para el espectador como para los creadores. Y puede ser una herramienta democratizadora, permitiendo acceder a recursos que se acerquen a tu visión artística. ¿Pero la IA podrá crear arte por sí sola? Aquí soy más escéptico: en mi opinión, no.

¿Siempre hará falta el prompt del creador humano, el que transmita una verdadera sensibilidad artística?

Exacto, lo que se puede mejorar es cómo interpreta la red neuronal. Las herramientas generativas de imágenes son esencialmente recombinadores. Lo sorprendente es lo bien que quedan, pero no dejan de ser interpolaciones.

El Programa Fundamentos pone el énfasis en la ciencia básica. ¿Es la 'ciencia por la ciencia', sin fines forzosamente prácticos, un campo a proteger?

Sí. Nadie cuestiona la apuesta del 'saber por saber', pero el apoyo de la administración pública es muy mejorable, tanto en términos económicos como cualitativos. Se tiende a dejar de lado la investigación de riesgo, y es hacer exactamente lo contrario de lo que hace la política europea de investigación de vanguardia, que apuesta por altos riesgos para obtener altos beneficios. En lugares no tan lejanos, como Alemania, se hace de otra manera, y yo creo que mejor.

Un compañero del Instituto de Óptica, Alejandro Manjavacas, lamentaba la rémora que supone la burocracia para la investigación en España.

Así es. Yo estuve 20 años en la universidad pública, y ahora puedo decirte que tenemos un problema gravísimo de burocracia interna. Nadie lo discute, empezando por la presidenta del CSIC. Y no parece que estemos avanzando lo suficientemente rápido para combatirlo. Por ejemplo, desde que tú concursas para una plaza en la universidad hasta que tomas posesión, pueden pasar tres meses. Pero aquí lo normal es que se tarde un año y medio. La nueva Ley de Ciencia no lo ha alterado para nada.

¿Qué soluciones tiene pendiente implantar España para mejorar la investigación con respecto al resto de países?

En general, parece que la investigación en España necesita más apoyo económico. Pero los investigadores necesitamos que nos quiten las trabas del día a día. Tenemos que encargarnos de aspectos burocráticos y de gestión. Es un despilfarro que el coste de una persona investigadora se dedique a tareas administrativas. Y necesitamos apostar por proyectos de riesgo. En la universidad, no lograba proyectos de ámbito regional y nacional. Pero cuando obtuve una Grant de la Agencia Europea de Investigación, se abrieron las compuertas. Fuer como: "Ah, vale, ya no es de riesgo, porque en todo caso quien se ha equivocado es el Consejo Europeo".