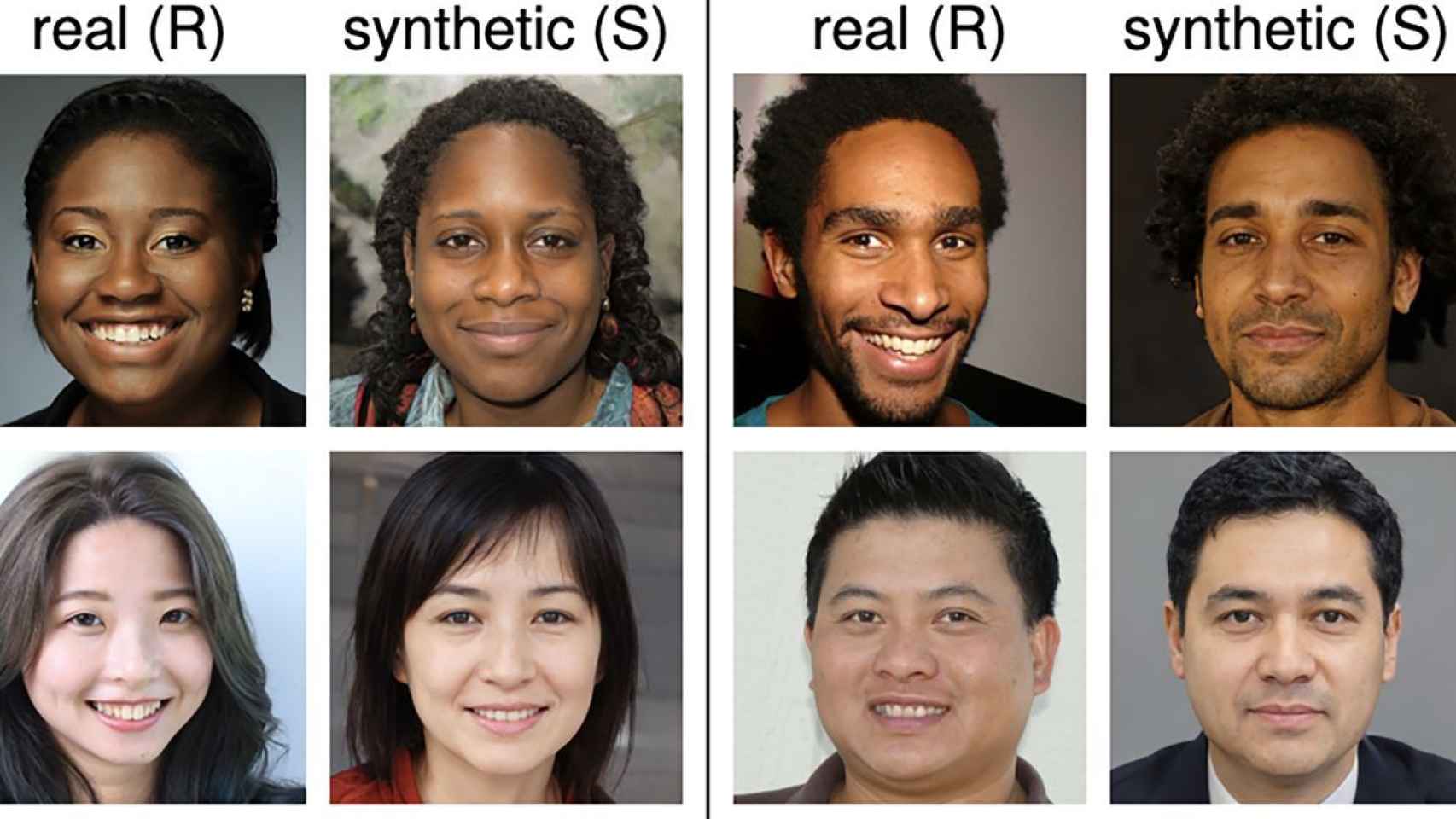

Imágenes reales frente a otras generadas artificialmente. Fuente: PNAS. Autores: Sophie J. Nightingale y Hany Farid.

Los 'deep fakes' son cada vez más realistas: expertos piden regularlos cuanto antes

Los riesgos que entraña la utilización de IA para generar contenido artificial hace imprescindible "una Constitución" que regule su utilización.

9 marzo, 2022 03:18Noticias relacionadas

"Puedes ser quien tú quieras" ha pasado de ser una frase que pretende animar al interlocutor a convertirse en una certera premonición de las capacidades de la tecnología futurista.

Los pasos agigantados que ha experimentado este sector han alcanzado lo que hasta hace pocos años se tachaba de ciencia ficción: la generación mediante inteligencia artificial (IA) de diferentes contenidos que simulan una realidad.

Entre otras funcionalidades, estas herramientas permiten sintetizar el habla de cualquier usuario, su apariencia física e incluso intercambiar su aspecto por el de otro personaje (en inglés, conocido como deep fake). Los efectos especiales de Hollywood han dejado de ser algo exclusivo de las grandes producciones.

Sin embargo, uno de los problemas que entraña la aplicación de esta tecnología es que en muchas ocasiones no se informa a los posibles destinatarios que han sido generados por una máquina -y por una persona detrás de ella- e intentan hacerse pasar por contenidos reales, tal y como advierte el presidente de We the humans, Juan Ignacio Rouyet.

A la par, la democratización de herramientas al alcance de todo tipo de personas que permiten generar imágenes, vídeos o textos ficticios de forma fácil mediante inteligencia artificial ha provocado graves consecuencias derivadas de usos malintencionados. Entre los más comunes, se encuentran la producción de campañas de desinformación, fraudes financieros o el desprestigio mediante la difusión de imágenes íntimas fake.

A esto se une el hecho de que, si se tiene en cuenta la posibilidad de que cualquier imagen o vídeo puede haber sido generado artificialmente en un mundo eminentemente digitalizado, la autenticidad de todo tipo de contenidos podría ponerse en duda en el momento en el que se considere inconveniente, lo sea o no.

En el lado contrario -y a pesar de la larga lista de problemas derivados de su mala praxis- también existen casos en los que las aplicaciones pueden generar resultados positivos, por ejemplo, el desarrollo del arte y la creatividad, componiendo todo tipo de imágenes casi sin límites.

Poniendo en una balanza todo lo que entraña la aplicación de este tipo de herramientas, el presidente de We the humans apunta que lo imprescindible al tratar con ella es ofrecer información básica sobre por qué se está usando y con qué finalidad. "Solo con eso ya se minimizan los riesgos", afirma.

Y es que, aunque se ha avanzado en el desarrollo de técnicas automáticas para detectar el contenido fake, los expertos lamentan que las herramientas actuales no son lo suficientemente precisas o efectivas para lidiar con la gran cantidad de actualizaciones diarias que se producen respecto a esta temática.

'Deep fakes' cada vez más reales y fiables

De hecho, según un estudio reciente realizado por los investigadores, Sophie J. Nightingale, perteneciente al Departamento de Psicología de la Universidad de Lancaster, y Hany Farid, del Departamento de Ingeniería eléctrica e informática de la Universidad de California, los humanos son incapaces de distinguir los rostros generados artificialmente de los reales y, además, los falsos les generan un mayor nivel de confianza que los verdaderos.

Ambos expertos llevaron a cabo un experimento en el que pidieron a 315 participantes que ordenasen, uno por uno, 128 de 800 rostros como reales o sintetizados, lo que se tradujo en una precisión media del 48,2%.

Tras esta prueba, los investigadores se dieron cuenta de que las caras caucásicas (de ambos géneros) fueron las que entrañaron un mayor grado de dificultad en su clasificación, ya que su sobrerrepresentación en el conjunto de datos de entrenamiento de los mecanismos que generan este tipo de contenidos hace que su parecido con la realidad sea mayor.

Por otro lado, los autores pidieron a los participantes que clasificasen el grado de fiabilidad que les generaban los rostros en una escala de 1 (poco fiable) a 7 (muy fiable), lo dio como resultado una media de 4,48 para los reales y un 4,82 para los sintéticos.

Así, Nightingale y Farid concluyeron que las imágenes de personas generadas sintéticamente ya no solo son altamente fotorrealistas, sino que son prácticamente indistinguibles e incluso más fiables debido a que tienden a parecerse más a los rostros promedio que, a su vez, generan mayor confianza.

Crear una Constitución para controlarlos

Ante los resultados de su investigación, ambos científicos instaron a buscar e imponer salvaguardas que ayuden a mitigar los daños que puedan derivarse de la aplicación de esta tecnología, algo en lo que coincide Rouyet, que precisa que no solo deben ser límites legales, sino también éticos.

Entre las propuestas para avanzar en este camino, el presidente de We the humans explica que debería existir un organismo externo que se dedique a auditar a las compañías que utilizan la inteligencia artificial para comprobar que informan a sus usuarios de que la están aplicando y les garantizan una serie de controles.

"Esto no va a evitar la innovación, lo que va a hacer es favorecerla de manera responsable, ética", afirma.

Más allá de las compañías, el directivo añade que la democratización de estas herramientas entre todo tipo de usuarios ha hecho necesario proporcionar mecanismos que permitan una identificación fiable de la persona detrás de su generación.

En concreto, precisa que es necesario buscar fórmulas de trazabilidad que faciliten la investigación en caso de que se utilice para fines dañinos.

Sin embargo, hasta que llegue ese momento en el que el seguimiento sea real, Rouyet explica que es necesario establecer unas normas del juego, ya que los riesgos aumentan "si no hay Constitución".

El presidente de We the humans señala que, actualmente, no hay reglas fijas porque están en proceso de creación, pero, cuando aparezcan, permitirán que esta tecnología se democratice y que lo haga bajo cierto control, lo que asegurará su uso razonable.

El experto afirma que la democratización "vendrá", pero advierte que lo que se necesitará, "como en toda democracia", será "una Constitución".