Los primeros experimentos se han hecho con varios drones realizando tareas como la detección y la extinción de incendios.

Investigación

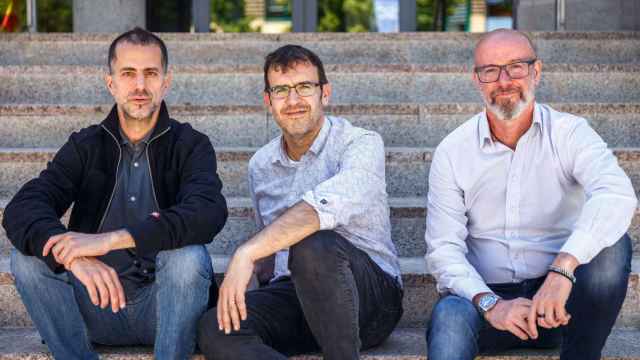

Investigadores del CSIC y la UPM crean un interfaz para controlar simultáneamente varios robots

El operador que controla los robots utiliza una herramienta con realidad virtual que le permite introducirse en el escenario donde los robots están desarrollando su trabajo

17 octubre, 2018 13:00Un equipo de investigadores de la Universidad Politécnica de Madrid (UPM) y del Consejo Superior de Investigaciones Científicas (CSIC) ha desarrollado una interfaz para optimizar el trabajo de los operadores de robots, ya que permite controlar simultáneamente las misiones de varios de ellos.

El operador que utiliza la interfaz usa una herramienta de realidad virtual para introducirse en el escenario donde los robots están desarrollando la misión. Desarrollada por investigadores del Centro de Automática y Robótica -mixto entre la UPM y el CSIC-, permite al operador "moverse por la escena buscando el mejor lugar para observar y dirigir con precisión a los robots para que realicen sus tareas".

Esta herramienta utiliza técnicas de aprendizaje automático para evaluar el riesgo de cada robot y, de este modo, poder mostrar al operador, por ejemplo, la columna de humo que sale de un dron que está en peligro o el foco que está apuntando al dron que realiza la tarea más crítica.

Durante la investigación se han llevado a cabo un conjunto de experimentos para probar la nueva interfaz y compararla con otra convencional. En estas pruebas, un grupo de operadores ha tenido que supervisar un conjunto de misiones con drones de detección y extinción de incendios empleando ambas interfaces. Los resultados demuestran que la interfaz de realidad virtual proporciona a los operadores una mejor consciencia de la situación, ya que les permite percibir mejor las rutas de los robots y las tareas realizadas por cada uno).

Además, otra de las ventajas de esta nueva herramienta es que supone una menor carga de trabajo para los operadores. De hecho, tras los experimentos, estos declaran que han hecho "un menor esfuerzo, con mayor rendimiento y menos frustración". El trabajador tiene que gestionar "una gran carga de trabajo", que consiste en "interpretar la información de la misión, tomar decisiones y generar comandos para los robots".

Por ello, señalan los investigadores, es clave que los operadores mantengan "una buena consciencia de la situación" y sean capaces de reconstruir el escenario a partir de los datos obtenidos por los robots para saber dónde están y qué están haciendo en cada momento. Por ejemplo, cuando se maneja una flota de drones buscando víctimas tras un desastre natural; o controlar a un grupo de robots humanoides como guías de museo, o a un equipo de robots terrestres aplicando tratamientos a cultivos.

Actualmente las misiones "requieren más operadores que robots", porque lo más habitual es que haya uno para controlar los movimientos y otro para analizar los datos de cada robot. El objetivo es que, "dentro de unos años, un solo operador pueda controlar simultáneamente varios robots", señala Juan Jesús Roldán, del grupo de Robótica y Cibernética de la UPM.

Los próximos pasos de esta investigación, cuyos resultados han sido publicados por la revista Sensors, consistirán en integrar una mayor variedad de escenarios (exteriores e interiores) y de robots (terrestres y aéreos) para probar nuevos métodos.

Este trabajo se ha realizado dentro del proyecto SAVIER (Situational Awareness VIrtual EnviRonment) de Airbus, en una colaboración entre la UPM, que desarrolló la interfaz, y la Universidad de Luxemburgo, donde se realizaron los experimentos con drones.